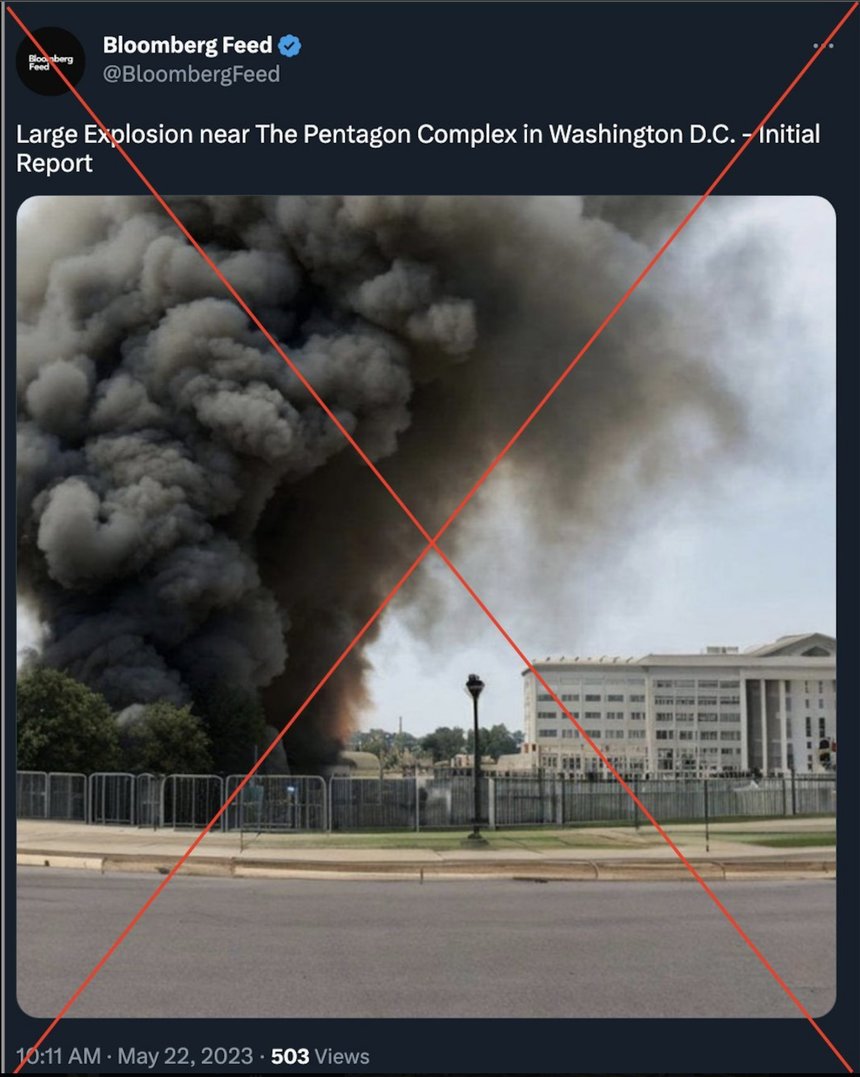

O imagine falsă care arată o explozie la Pentagon a devenit virală, luni, pe Twitter, provocând o prăbuşire a pieţelor timp de zece minute şi reaprinzând dezbaterea în jurul riscurilor asociate cu inteligenţa artificială, relatează AFP.

Fotografia falsă, aparent realizată cu ajutorul unui program de inteligenţă artificială generativă (capabil să producă texte şi imagini pornind de la o simplă întrebare), a obligat Departamentul american al Apărării să reacţioneze. "Putem confirma că este vorba de o informaţie falsă şi că Pentagonul nu a fost atacat astăzi", a declarat un purtător de cuvânt.

Pompierii din zona în care se află clădirea (în Arlington, în apropiere de Washington D.C.) au intervenit, de asemenea, pe Twitter pentru a spune că nu au avut loc explozii sau incidente, nici în Pentagon, nici în apropiere de acesta.

Imaginea a părut să trimită însă pieţele într-o degringoladă pentru câteva minute, S&P 500 pierzând 0,29% din valoare faţă de vineri, înainte de a-şi reveni. "A existat o scădere legată de această informaţie falsă depistată de programe", a confirmat Pat O'Hare de la Briefing.com, referindu-se la softurile automate de tranzacţionare care sunt programate să reacţioneze la postările de pe reţelele sociale. "Dar faptul că a rămas la o reacţie limitată faţă de conţinutul ştirilor false sugerează că şi alţii au considerat că acestea sunt înşelătoare", a declarat el pentru AFP.

Un cont al mişcării conspiraţioniste QAnon a fost printre primele care a transmis imaginea falsă, a cărei sursă nu este cunoscută.

Earlier today an apparent AI-generated photo showed a fake explosion near the US Pentagon. The news was shared by Russian state-media RT on Twitter, which helped it go viral.

— Ed Krassenstein (@EdKrassen) May 22, 2023

It was also tweeted by a verified Twitter account called “BloombegFeed” which has now been suspended.… pic.twitter.com/KN1wOptlRb

Incidentul survine după ce mai multe fotografii false produse cu ajutorul inteligenţei artificiale generative au fost difuzate pe scară largă pentru a arăta capacităţile acestei tehnologii, cum ar fi cea a arestării fostului preşedinte american Donald Trump sau cea a Papei cu o geacă de puf. Programe precum DALL-E 2, Midjourney şi Stable Diffusion permit amatorilor să creeze imagini false convingătoare fără a fi nevoie să stăpânească programe de editare precum Photoshop. Dar, în timp ce inteligenţa artificială generativă facilitează crearea de conţinuturi false, problema difuzării şi a viralizării acestora - cele mai periculoase componente ale dezinformării - ţine de platforme, reamintesc experţii. "Utilizatorii folosesc aceste instrumente pentru a genera conţinuturi mai eficient decât înainte (...), dar acestea se răspândesc în continuare prin intermediul reţelelor sociale", a subliniat Sam Altman, şeful OpenAI (DALL-E, ChatGPT), în cadrul unei audieri în Congres la jumătatea lunii mai.

Articolul de mai sus este destinat exclusiv informării dumneavoastră personale. Dacă reprezentaţi o instituţie media sau o companie şi doriţi un acord pentru republicarea articolelor noastre, va rugăm să ne trimiteţi un mail pe adresa abonamente@news.ro.